Documentation Index

Fetch the complete documentation index at: https://docs.bigmodel.cn/llms.txt

Use this file to discover all available pages before exploring further.

概览

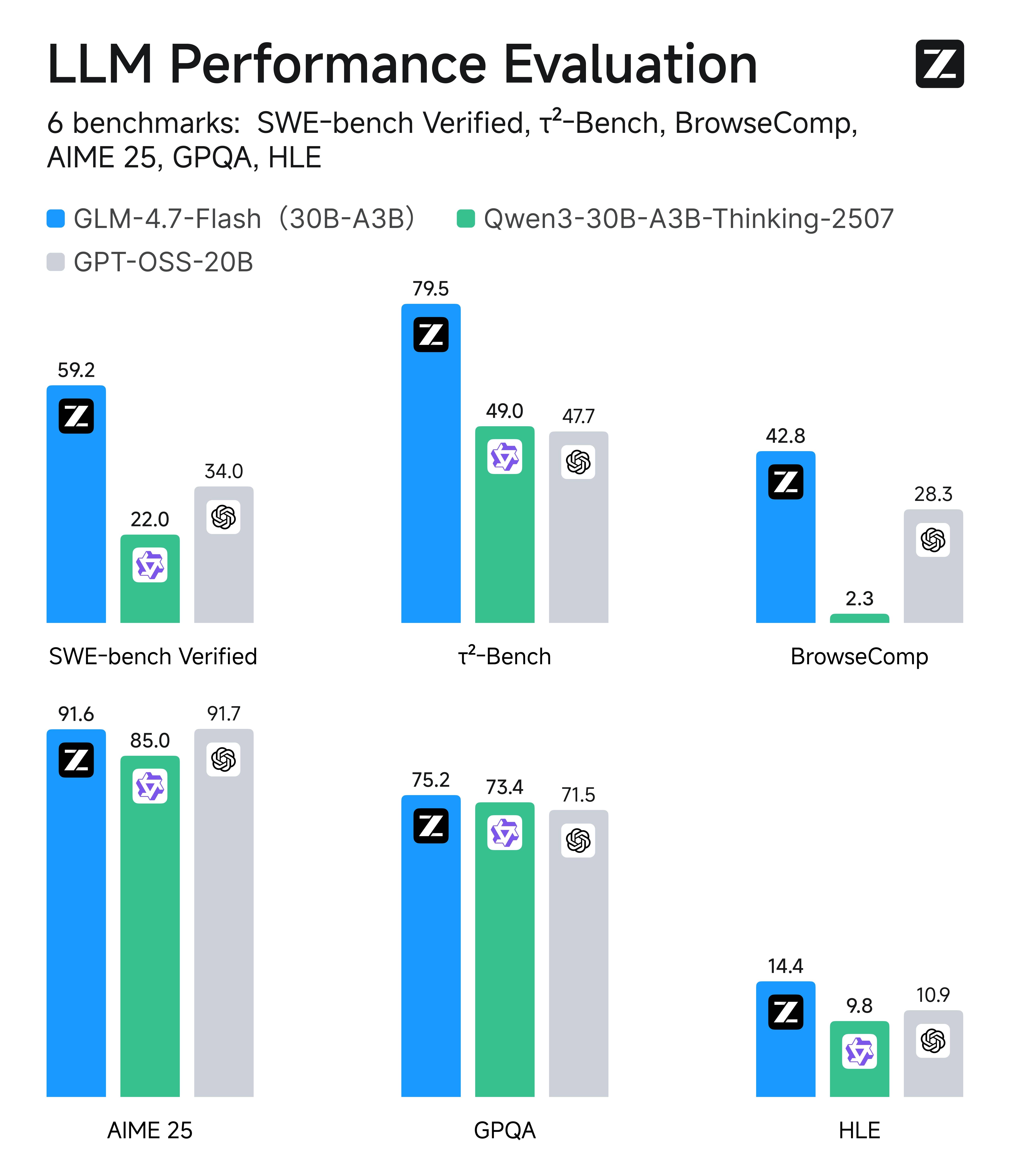

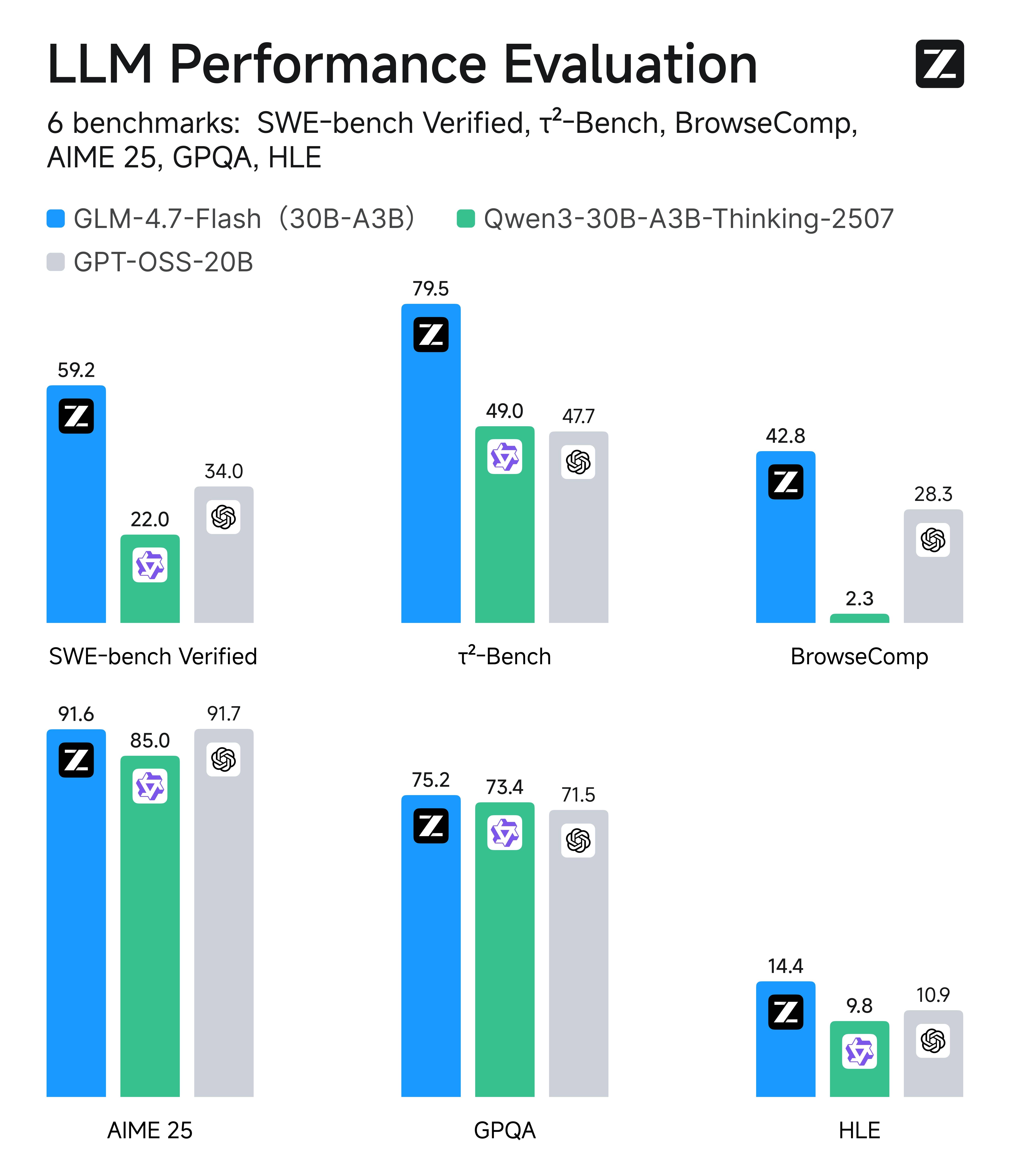

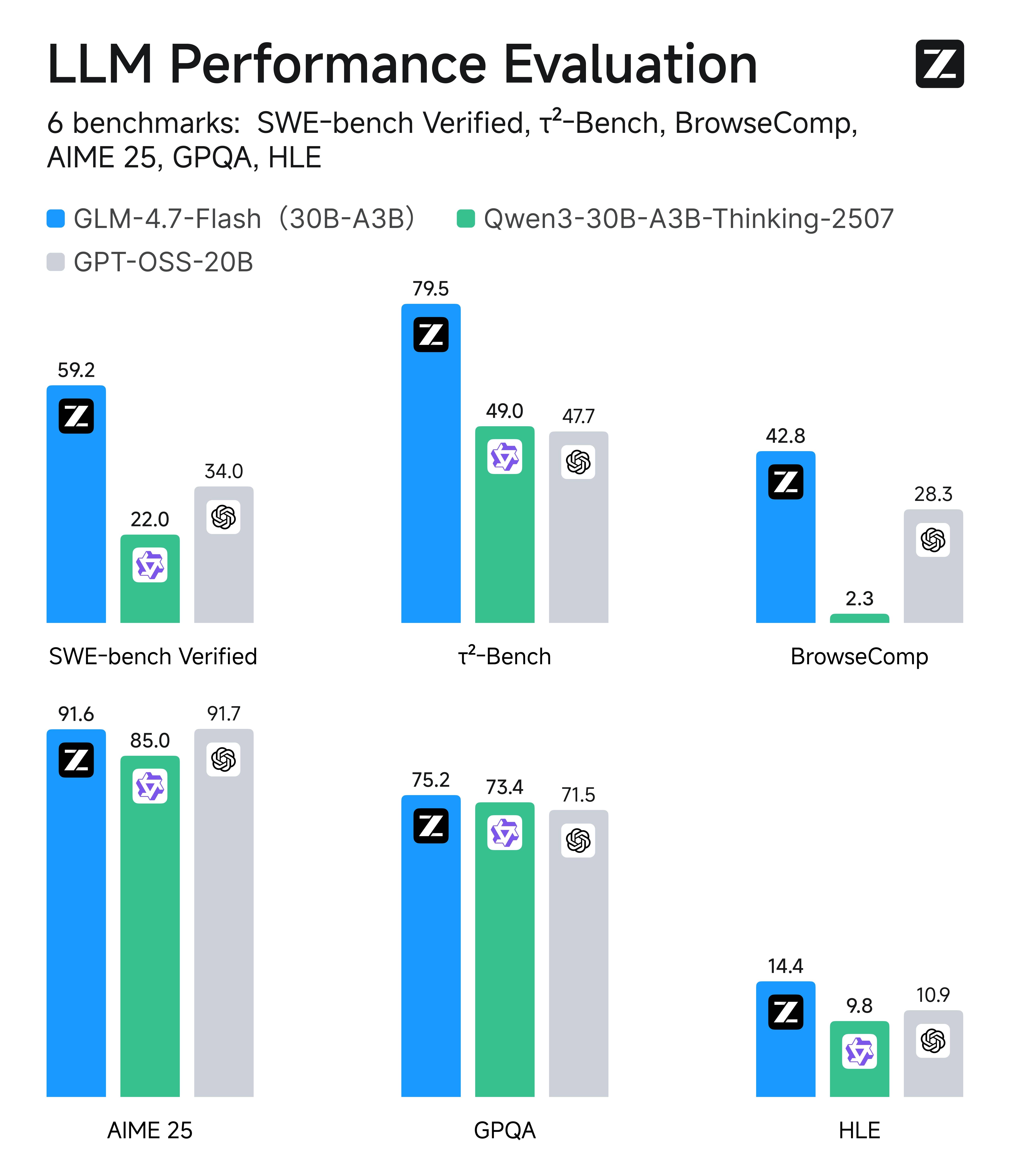

GLM-4.7-Flash 作为 30B 级 SOTA 模型,提供了一个兼顾性能与效率的新选择。面向 Agentic Coding 场景强化了编码能力、长程任务规划与工具协同,并在多个公开基准的当期榜单中取得同尺寸开源模型中的出色表现。在执行复杂智能体任务,在工具调用时指令遵循更强,Artifacts 与 Agentic Coding 的前端美感和长程任务完成效率进一步提升。

能力支持

Function Call

强大的工具调用能力,支持多种外部工具集成

结构化输出

支持 JSON 等结构化格式输出,便于系统集成

MCP

可灵活调用外部 MCP 工具与数据源,扩展应用场景

推荐场景

GLM-4.7 面向「任务完成」而非单点代码生成,能够从目标描述出发,自主完成需求理解、方案拆解与多技术栈整合。在包含前后端联动、实时交互与外设调用的复杂场景中,可直接生成结构完整、可运行的代码框架,显著减少人工拼装与反复调试成本,适合复杂 Demo、原型验证与自动化开发流程。

在需要摄像头、实时输入与交互控制的场景中,GLM-4.7 展现出更强的系统级理解能力。能够将视觉识别、逻辑控制与应用代码整合为统一方案,支持如手势控制、实时反馈等交互式应用的快速构建,加速从想法到可运行应用的落地过程。

对视觉代码与 UI 规范的理解显著增强。GLM-4.7 能在布局结构、配色和谐度与组件样式上给出更具美感且一致的默认方案,减少样式反复“微调”的时间成本,适合低代码平台、AI 前端生成工具及快速原型设计场景。

在多轮对话中更稳定地保持上下文与约束条件,对简单问题回应更直接,对复杂问题能够持续澄清目标并推进解决路径。GLM-4.7 更像一名可协作的“问题解决型伙伴”,适用于开发支持、方案讨论与决策辅助等高频协作场景。

文字表达更细腻、更具画面感,能够通过气味、声音、光影等感官细节构建氛围。在角色扮演与叙事创作中,对世界观与人设的遵循更加稳定,剧情推进自然有张力,适合互动叙事、IP 内容创作与角色型应用。

在办公创作中,GLM-4.7 的版式遵循与审美稳定性明显提升。能够稳定适配 16:9 等主流比例,在字体层级、留白与配色上减少模板感,生成结果更接近“即用级”,适合 AI 演示工具、企业办公系统与自动化内容生成场景。

强化用户意图理解、信息检索与结果融合能力。在复杂问题与研究型任务中,GLM-4.7 不仅返回信息,还能进行结构化整理与跨来源整合,通过多轮交互持续逼近核心结论,适合深度研究与决策支持场景。

详细介绍

小而强的 Coding Agent

GLM-4.7 系列在编程、推理与智能体三个维度实现了显著突破:

- 更强的编程能力:显著提升了模型在多语言编码和在终端智能体中的效果;现在可以在 Claude Code、Kilo Code、TRAE、Cline 和 Roo Code 等编程框架中实现“先思考、再行动”的机制,在复杂任务上有更稳定的表现

- 前端审美提升:GLM-4.7 系列模型在前端生成质量方面明显进步,能够生成观感更佳的网页、PPT 、海报

- 工具调用与协同执行更强: 增强对复杂链路的任务拆解与流程编排能力,可在多步执行中持续校验与纠偏,更适合端到端交付类的智能体任务。

- 通用能力增强:GLM-4.7 系列模型的对话更简洁智能且富有人情味,写作与角色扮演更具文采与沉浸感

在SWE-bench Verified、τ²-Bench等主流基准测试中,GLM-4.7-Flash 的综合表现在相同尺寸模型系列中取得开源SOTA分数。另外,相比于同尺寸模型,GLM-4.7-Flash同样具有出色的前端和后端开发能力。在内部的编程实测中,GLM-4.7-Flash在前后端任务上表现出色。在编程场景之外,我们也推荐大家在中文写作、翻译、长文本、情感/角色扮演等通用场景中体验GLM-4.7-Flash。

使用资源

体验中心:快速测试模型在业务场景上的效果

接口文档:API 调用方式

调用示例

以下是完整的调用示例,帮助您快速上手 GLM-4.7-Flash 模型。

cURL

Python

Java

Python(旧)

基础调用curl -X POST "https://open.bigmodel.cn/api/paas/v4/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer your-api-key" \

-d '{

"model": "glm-4.7-flash",

"messages": [

{

"role": "user",

"content": "作为一名营销专家,请为我的产品创作一个吸引人的口号"

},

{

"role": "assistant",

"content": "当然,要创作一个吸引人的口号,请告诉我一些关于您产品的信息"

},

{

"role": "user",

"content": "智谱AI 开放平台"

}

],

"thinking": {

"type": "enabled"

},

"max_tokens": 65536,

"temperature": 1.0

}'

curl -X POST "https://open.bigmodel.cn/api/paas/v4/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer your-api-key" \

-d '{

"model": "glm-4.7-flash",

"messages": [

{

"role": "user",

"content": "作为一名营销专家,请为我的产品创作一个吸引人的口号"

},

{

"role": "assistant",

"content": "当然,要创作一个吸引人的口号,请告诉我一些关于您产品的信息"

},

{

"role": "user",

"content": "智谱开放平台"

}

],

"thinking": {

"type": "enabled"

},

"stream": true,

"max_tokens": 65536,

"temperature": 1.0

}'

安装 SDK# 安装最新版本

pip install zai-sdk

# 或指定版本

pip install zai-sdk==0.2.2

import zai

print(zai.__version__)

from zai import ZhipuAiClient

client = ZhipuAiClient(api_key="your-api-key") # 请填写您自己的 API Key

response = client.chat.completions.create(

model="glm-4.7-flash",

messages=[

{"role": "user", "content": "作为一名营销专家,请为我的产品创作一个吸引人的口号"},

{"role": "assistant", "content": "当然,要创作一个吸引人的口号,请告诉我一些关于您产品的信息"},

{"role": "user", "content": "智谱开放平台"}

],

thinking={

"type": "enabled", # 启用深度思考模式

},

max_tokens=65536, # 最大输出 tokens

temperature=1.0 # 控制输出的随机性

)

# 获取完整回复

print(response.choices[0].message)

from zai import ZhipuAiClient

client = ZhipuAiClient(api_key="your-api-key") # 请填写您自己的 API Key

response = client.chat.completions.create(

model="glm-4.7-flash",

messages=[

{"role": "user", "content": "作为一名营销专家,请为我的产品创作一个吸引人的口号"},

{"role": "assistant", "content": "当然,要创作一个吸引人的口号,请告诉我一些关于您产品的信息"},

{"role": "user", "content": "智谱开放平台"}

],

thinking={

"type": "enabled", # 启用深度思考模式

},

stream=True, # 启用流式输出

max_tokens=65536, # 最大输出tokens

temperature=1.0 # 控制输出的随机性

)

# 流式获取回复

for chunk in response:

if chunk.choices[0].delta.reasoning_content:

print(chunk.choices[0].delta.reasoning_content, end='', flush=True)

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end='', flush=True)

安装 SDKMaven<dependency>

<groupId>ai.z.openapi</groupId>

<artifactId>zai-sdk</artifactId>

<version>0.3.3</version>

</dependency>

implementation 'ai.z.openapi:zai-sdk:0.3.3'

import ai.z.openapi.ZhipuAiClient;

import ai.z.openapi.service.model.ChatCompletionCreateParams;

import ai.z.openapi.service.model.ChatCompletionResponse;

import ai.z.openapi.service.model.ChatMessage;

import ai.z.openapi.service.model.ChatMessageRole;

import ai.z.openapi.service.model.ChatThinking;

import java.util.Arrays;

public class BasicChat {

public static void main(String[] args) {

// 初始化客户端

ZhipuAiClient client = ZhipuAiClient.builder().ofZHIPU()

.apiKey("your-api-key")

.build();

// 创建聊天完成请求

ChatCompletionCreateParams request = ChatCompletionCreateParams.builder()

.model("glm-4.7-flash")

.messages(Arrays.asList(

ChatMessage.builder()

.role(ChatMessageRole.USER.value())

.content("作为一名营销专家,请为我的产品创作一个吸引人的口号")

.build(),

ChatMessage.builder()

.role(ChatMessageRole.ASSISTANT.value())

.content("当然,要创作一个吸引人的口号,请告诉我一些关于您产品的信息")

.build(),

ChatMessage.builder()

.role(ChatMessageRole.USER.value())

.content("智谱开放平台")

.build()

))

.thinking(ChatThinking.builder().type("enabled").build())

.maxTokens(65536)

.temperature(1.0f)

.build();

// 发送请求

ChatCompletionResponse response = client.chat().createChatCompletion(request);

// 获取回复

if (response.isSuccess()) {

Object reply = response.getData().getChoices().get(0).getMessage();

System.out.println("AI 回复: " + reply);

} else {

System.err.println("错误: " + response.getMsg());

}

}

}

import ai.z.openapi.ZhipuAiClient;

import ai.z.openapi.service.model.ChatCompletionCreateParams;

import ai.z.openapi.service.model.ChatCompletionResponse;

import ai.z.openapi.service.model.ChatMessage;

import ai.z.openapi.service.model.ChatMessageRole;

import ai.z.openapi.service.model.ChatThinking;

import ai.z.openapi.service.model.Delta;

import java.util.Arrays;

public class StreamingChat {

public static void main(String[] args) {

// 初始化客户端

ZhipuAiClient client = ZhipuAiClient.builder().ofZHIPU()

.apiKey("your-api-key")

.build();

// 创建流式聊天完成请求

ChatCompletionCreateParams request = ChatCompletionCreateParams.builder()

.model("glm-4.7-flash")

.messages(Arrays.asList(

ChatMessage.builder()

.role(ChatMessageRole.USER.value())

.content("作为一名营销专家,请为我的产品创作一个吸引人的口号")

.build(),

ChatMessage.builder()

.role(ChatMessageRole.ASSISTANT.value())

.content("当然,要创作一个吸引人的口号,请告诉我一些关于您产品的信息")

.build(),

ChatMessage.builder()

.role(ChatMessageRole.USER.value())

.content("智谱开放平台")

.build()

))

.thinking(ChatThinking.builder().type("enabled").build())

.stream(true) // 启用流式输出

.maxTokens(65536)

.temperature(1.0f)

.build();

ChatCompletionResponse response = client.chat().createChatCompletion(request);

if (response.isSuccess()) {

response.getFlowable().subscribe(

// Process streaming message data

data -> {

if (data.getChoices() != null && !data.getChoices().isEmpty()) {

Delta delta = data.getChoices().get(0).getDelta();

System.out.print(delta + "\n");

}

},

// Process streaming response error

error -> System.err.println("\nStream error: " + error.getMessage()),

// Process streaming response completion event

() -> System.out.println("\nStreaming response completed")

);

} else {

System.err.println("Error: " + response.getMsg());

}

}

}

更新 SDK 至 2.1.5.20250726# 安装最新版本

pip install zhipuai

# 或指定版本

pip install zhipuai==2.1.5.20250726

from zhipuai import ZhipuAI

client = ZhipuAI(api_key="your-api-key") # 请填写您自己的 API Key

response = client.chat.completions.create(

model="glm-4.7-flash",

messages=[

{"role": "user", "content": "作为一名营销专家,请为我的产品创作一个吸引人的口号"},

{"role": "assistant", "content": "当然,要创作一个吸引人的口号,请告诉我一些关于您产品的信息"},

{"role": "user", "content": "智谱开放平台"}

],

thinking={

"type": "enabled",

},

max_tokens=65536,

temperature=1.0

)

# 获取完整回复

print(response.choices[0].message)

from zhipuai import ZhipuAI

client = ZhipuAI(api_key="your-api-key") # 请填写您自己的 API Key

response = client.chat.completions.create(

model="glm-4.7-flash",

messages=[

{"role": "user", "content": "作为一名营销专家,请为我的产品创作一个吸引人的口号"},

{"role": "assistant", "content": "当然,要创作一个吸引人的口号,请告诉我一些关于您产品的信息"},

{"role": "user", "content": "智谱开放平台"}

],

thinking={

"type": "enabled",

},

stream=True, # 启用流式输出

max_tokens=65536,

temperature=1.0

)

# 流式获取回复

for chunk in response:

if chunk.choices[0].delta.reasoning_content:

print(chunk.choices[0].delta.reasoning_content, end='', flush=True)

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end='', flush=True)